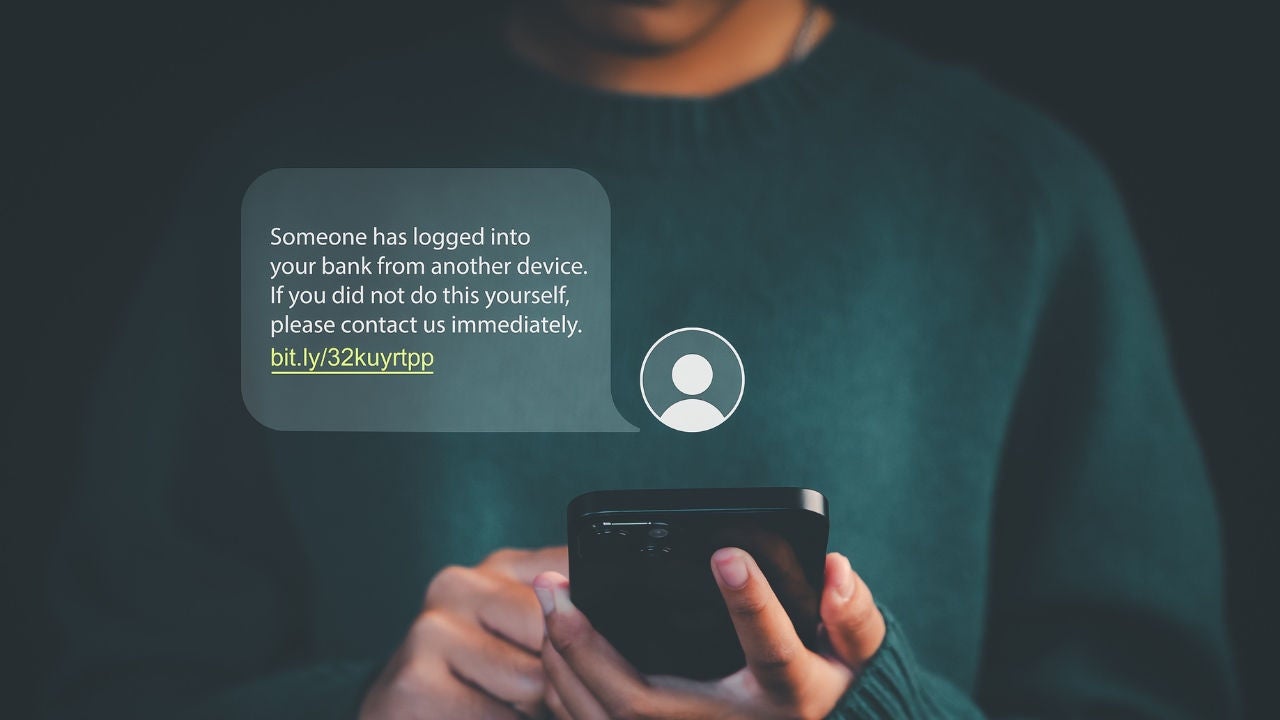

Онлайн-мошенники уже используют LLM, чтобы писать более убедительные и целенаправленные фишинговые письма, и делают это в гораздо большем масштабе, чем они могли бы сделать без инструментов ИИ.

Прошли те времена, когда плохо составленные шаблонные электронные письма, которые даже человек, не разбирающийся в технологиях, мог распознать как мошеннические, не представляли собой ничего подозрительного. Мошенники, для которых английский не является родным языком, теперь мастерски оттачивают свои сообщения, используя знания, полученные в магистратуре.

И даже те мошенники, выдающие себя за одиноких солдат, размещённых за рубежом, продвигающие бизнес-возможность, которая выглядит слишком хорошо, чтобы быть правдой (хотя на самом деле это так), добавляют личные данные, добытые ИИ, чтобы сделать эти сообщения гораздо более правдоподобными.

Они также вышли за рамки электронной почты, доставляя свои теперь хорошо продуманные сообщения в социальные сети, сообщения и даже телефонные звонки.

В то же время наблюдается рост числа мошеннических сообщений с аудио- или видеодипфейками. В прошлом году работника в Гонконге обманули, заставив выплатить мошенникам 25 миллионов долларов после того, как он принял участие в видеозвонке с представителями своей транснациональной компании, включая финансового директора. Но оказалось, что остальные участники звонка были живыми дипфейковыми воссозданиями этих людей.

Потребители также стали мишенью в аудиодипфейковых мошенничествах. Именно тогда киберпреступники используют ИИ для дипфейка голосов людей, обычно молодых, а затем имитируют голос, чтобы звонить членам семьи и сообщать, что их похитили или они находятся в тюрьме, чтобы вымогать у них деньги.

Всё это, вполне объяснимо, пугает как компании, так и потребителей. Недавнее исследование, проведенное для Mastercard , в котором приняли участие около 13 000 потребителей по всему миру, включая около 1000 в США, показало, что создание поддельного контента с помощью искусственного интеллекта является главной проблемой, связанной с мошенничеством, в будущем. Однако лишь 13% опрошенных заявили, что очень уверены в своей способности выявлять угрозы или мошеннические схемы, созданные искусственным интеллектом, если они станут их жертвами.

Подавляющее большинство опрошенных конкретно указывали на опасения по поводу более изощренных атак со стороны систем искусственного интеллекта, которые взламываются и превращаются в вредоносные, автоматизированных крупномасштабных кибератак и более убедительных фишинговых писем, создаваемых ИИ.

А обеспокоенные потребители могут создать серьезные проблемы для компаний, которые их обслуживают. Если потребители не могут быть уверены в том, что имеют дело с законной компанией или что их личная информация находится в безопасности, они могут предпочесть обратиться к другому поставщику услуг.