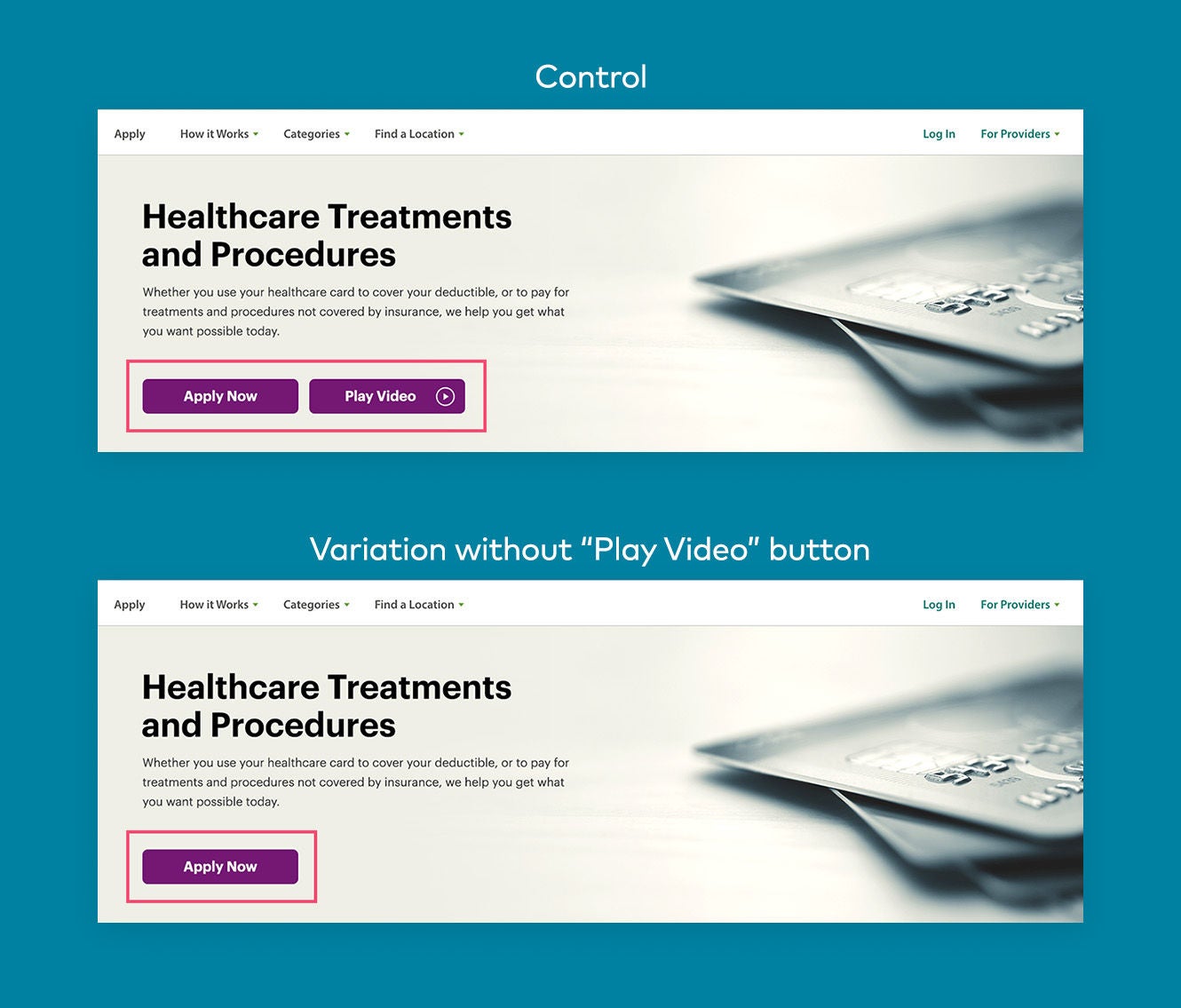

Das Grundprinzip von A/B-Tests ist einfach:

Vergleiche zwei (oder mehr) verschiedene Versionen von etwas, um zu sehen, welche besser funktioniert, und stelle dann die Gewinnerversion allen Benutzern zur Verfügung, um ein optimales Gesamterlebnis zu gewährleisten.

Die Praxis von A/B-Testing- und CRO-Teams besteht daher darin, erheblich in die Durchführung aller Arten von Experimenten zu investieren, um verschiedene Bereiche und Erfahrungen auf der Website, in der nativen App, in E-Mails oder auf anderen digitalen Kanälen zu verbessern und diese dann kontinuierlich zu optimieren, um im Laufe der Zeit eine schrittweise Steigerung der Konversionsraten und bestimmter KPIs zu erzielen.

Sofern ein Unternehmen jedoch nicht Unmengen an Traffic generiert und über eine riesige digitale Landschaft verfügt, in der es experimentieren kann, kann es zu einem Punkt kommen, an dem der Nutzen der Experimente abnimmt und der Output (egal wie viele Tests es gibt oder wie groß und ausgefeilt ein Experiment ist) in Bezug auf den Input dieser Teams ein Maximum erreicht.

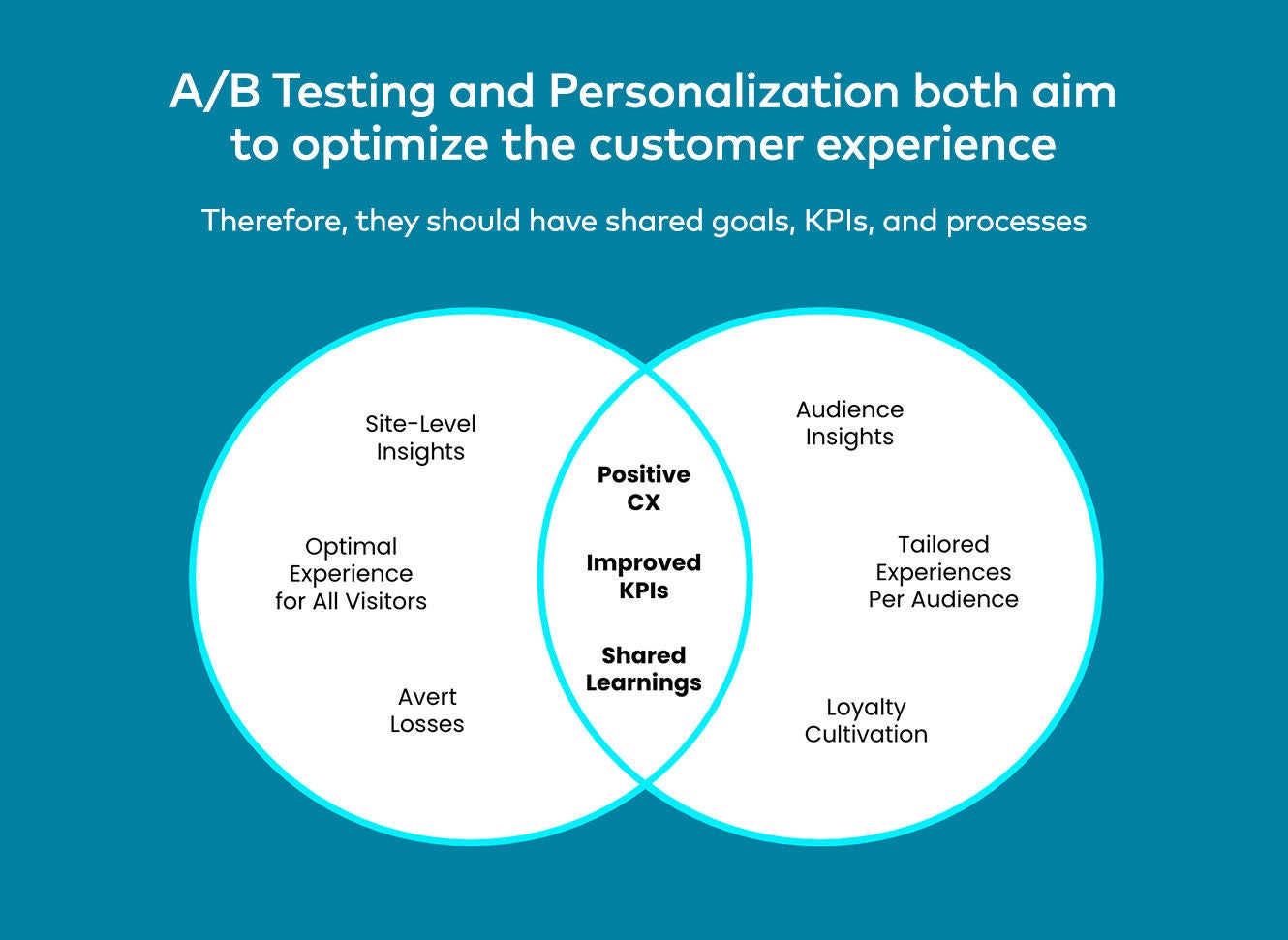

Dies liegt vor allem daran, dass der klassische Ansatz beim A/B-Testing eine binäre Sicht auf die Präferenzen der Besucher bietet und oft nicht die gesamte Bandbreite an Faktoren und Verhaltensweisen erfasst, die sie als Individuen ausmachen.

Darüber hinaus liefern A/B-Tests verallgemeinerte Ergebnisse, die auf den Präferenzen der Mehrheit eines Segments basieren. Und obwohl eine Marke feststellen mag, dass ein bestimmtes Nutzererlebnis im Durchschnitt höhere Umsätze generiert, wäre es ein Nachteil für einen erheblichen Teil der Verbraucher mit anderen Vorlieben, dieses Nutzererlebnis allen Nutzern anzubieten.

Ich möchte dies an einigen Beispielen verdeutlichen:

Wenn das durchschnittliche Nettovermögen von mir und Warren Buffett jeweils 117,3 Milliarden US-Dollar betragen würde, wäre es dann sinnvoll, uns dieselben Produkte zu empfehlen?

Vermutlich nicht.

Oder was wäre, wenn ein Einzelhändler, der sowohl Herren- als auch Damenprodukte anbietet, beschließt, einen klassischen A/B-Test auf seiner Homepage durchzuführen, um die leistungsstärkste Hero-Banner-Variante zu ermitteln? Da aber 70 % seiner Zielgruppe Frauen sind, schneidet die Damenvariante besser ab als die Herrenvariante.

Dieser Test würde nahelegen, dass das Banner der weiblichen Heldin auf die gesamte Bevölkerung angewendet werden sollte, aber das wäre sicherlich nicht die richtige Entscheidung.

Einfach ausgedrückt:

- Durchschnittswerte sind oft irreführend, wenn sie zum Vergleich verschiedener Nutzergruppen herangezogen werden.

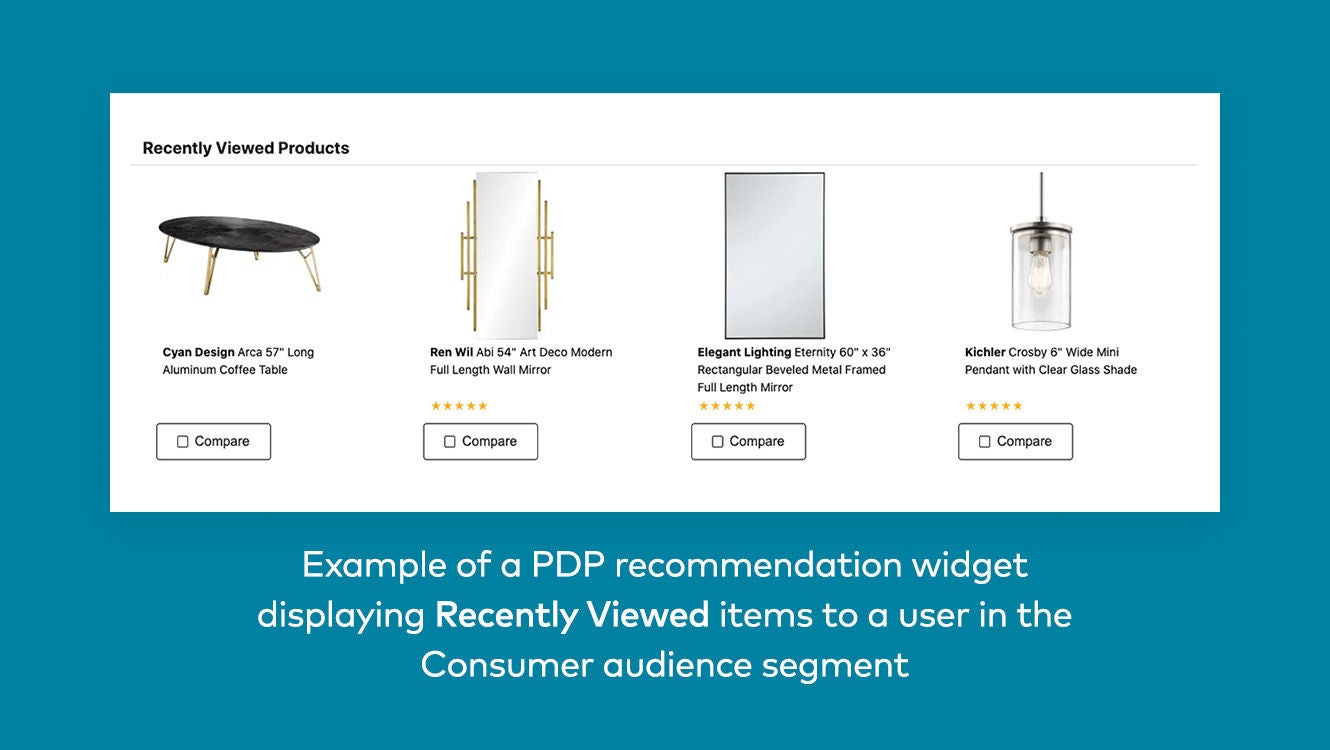

- Die leistungsstärkste Variante variiert je nach Kundensegment und Nutzer.

- Die Ergebnisse können auch durch Kontextfaktoren wie Geografie, Wetter und mehr beeinflusst werden.

Das soll natürlich nicht heißen, dass es nicht auch Situationen gibt, in denen allgemeinere Ergebnisse von Nutzen sind. Wenn Sie beispielsweise ein neues Website- oder App-Design testen würden, wäre es sinnvoll, eine einheitliche Benutzeroberfläche anzustreben, die im Durchschnitt am besten funktioniert, anstatt Dutzende, Hunderte oder sogar Tausende von UI-Variationen für verschiedene Benutzer zu erstellen.

Die Zeiten, in denen man beim Layout einer Seite, bei Botschaften, Inhalten, Empfehlungen, Angeboten und anderen kreativen Elementen getreu dem Motto „Der Gewinner bekommt alles“ folgte, sind jedoch vorbei – und das ist gut so, denn es bedeutet, dass kein Geld mehr verschenkt wird, weil man Personalisierungsmöglichkeiten verpasst, indem man nicht jedem einzelnen Nutzer die beste Variante liefert.